지금은 AI 에이전트 시대, 어떻게 대비해야 하나? (Now is the Era of AI Agents: How Should We Prepare?)

인공지능이 빠르게 발전하는 현대에서, 기존의 챗봇보다 더 큰 자율성을 가진 AI 에이전트들과 함께 새로운 시대가 도래하고 있다. 이는 중요한 질문을 내포한다: 우리는 인간의 능력을 뛰어넘을 수 있는 에이전트들을 다룰 준비가 되어 있을까?

CES 2025의 가장 두드러진 특징 중 하나는 IoT 센서의 보편화였다. 이러한 센서들은 인체의 감각과 같은 중요한 역할을 하며, 환경을 이해하고 해석하는 데 필수적인 데이터를 제공한다. "쓰레기를 넣으면 쓰레기가 나온다"는 격언은 AI 시대에도 여전히 유효하며, 이는 고품질 데이터의 필요성을 강조한다. 현재 AI의 트렌드는 에이전트 기반 시스템으로 향하고 있다. AI 기업들이 개발한 이러한 에이전트들은 개인이나 조직을 대신해 특정 작업을 수행하고 외부 애플리케이션과 자율적으로 상호작용하도록 설계되었다. 일부 전문가들은 반복적인 화이트칼라 업무를 줄일 수 있다는 이점을 강조하지만, 안전성보다 속도를 우선시하는 것이 상당한 위험을 초래할 수 있다는 우려가 있다. AI 에이전트의 광범위한 사용은 실제로 법적, 경제적 문제를 초래할 수 있기 때문이다.

AI 에이전트들은 최소한의 인간 개입으로 자율적으로 작동하며, 대형 기술 기업들의 주요 관심사가 되어 막대한 투자를 유치한 결과로 나타나고 있다. OpenAI는 에이전트가 인공일반지능(AGI)을 향한 5단계 중 3단계에 해당한다고 주장하며 "Operator"라는 에이전트를 출시한다. 한편, 메타의 마크 저커버그는 AI 에이전트가 궁극적으로 인간의 능력을 뛰어넘을 것이라 예측하며, 3,600명의 소프트웨어 엔지니어를 포함한 인력 감축을 단행하고 있다.

AI 발전 5단계 (블룸버그 보고서)

|

Level 1 |

챗봇, 대화형 언어를 사용하는 AI |

|

Level 2 |

추론자, 인간 수준의 문제 해결 |

|

Level 3 |

에이전트, 행동을 수행할 수 있는 시스템 |

|

Level 4 |

혁신자, 발명을 지원할 수 있는 AI |

|

Level 1 |

조직, 조직의 업무를 수행할 수 있는 AI |

AI 에이전트를 둘러싼 어두운 전망에도 불구하고, 낙관적인 시각도 존재한다. 구글 딥마인드의 선임 연구원인 이아손 가브리엘은 단순 작업을 넘어 관계 지향적이고 인지적 성장을 지원하여 개인의 정보에 기반한 의사결정을 돕는 것을 목표로 하는 프로젝트 아스트라 (Project Astra)를 발표했다. 또한, 세일즈포스의 최고 과학자인 실비오 사바레스는 자사의 에이전트포스(Agentforce)와 같은 AI 에이전트들이 기업뿐만 아니라 개인도 지원할 것으로 전망한다. 이러한 에이전트들은 사용자의 선호도와 과거 상호작용을 기억하여 휴가 계획, 항공권 예약, 레스토랑 예약, 예상치 못한 여행 상황에 대한 적응 등의 작업을 처리할 수 있다. 아마존도 쇼핑 이력을 기반으로 제품을 추천하는 에이전트를 개발 중인 것으로 알려졌다.

AI 에이전트는 강력한 AI 모델들을 연결하고 매번 반복할 때마다 성능을 최적화하는 강화학습을 활용함으로써 잠재적으로 인간의 능력을 뛰어넘을 수 있다. 에이전트와 의식 사이에 존재론적 연결성이 있지만, AI가 자의식을 발달시킬 것이라는 징후는 없다. 대형 기술 기업들도 자사의 AI가 자유의지를 가진 존재에 가깝다고 광고하지 않는다. 하지만 인간의 수백만년에 걸친 진화의 결과를 의식을 가지게 되었다는 점을 고려할 때, 사람들이 AI 에이전트를 의식이 있는 존재로 인식할 수 있는 가능성은 남는다.

전문가들은 AI 에이전트를 통한 AGI 개발의 영향에 대해 심각한 우려를 표명하며 법적 규제 도입을 주장하고 있다. 금융 부문에서 에이전트가 자신이 서명한 계약을 위반하는 시나리오를 고려해보면, 그 책임이 기업에 있는지 아니면 에이전트 자체에 있는지에 대한 문제가 제기된다. 기업에 법인격이 부여되는 것처럼, 이러한 문제를 해결하기 위해 AI 에이전트에게도 유사한 지위를 부여해야 할 수도 있는 것이다.

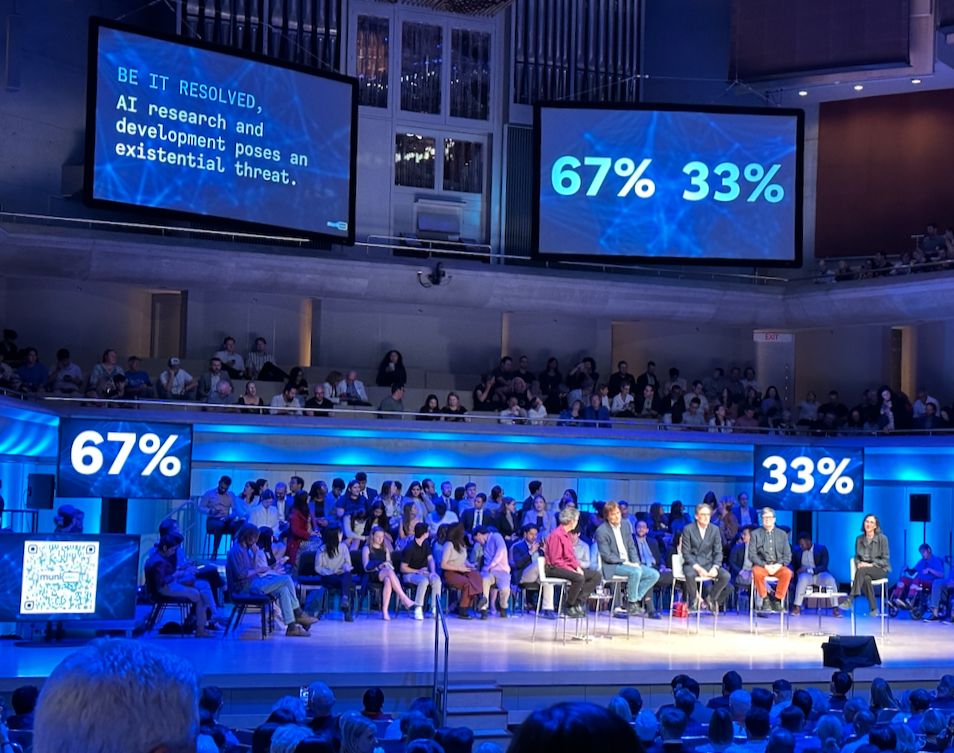

또한 근본적인 정렬(alignment) 문제도 있다: AI 에이전트의 자율성이 증가함에 따라, 그들의 의사결정 과정을 인간이 이해할 수 없게 될 수 있기 때문이다. 저명한 AI 연구자인 요슈아 벤지오는 수익 극대화와 공공 안전 사이의 이해 상충을 지적하고 있다. 예를 들어, 페이스북의 알고리즘은 한때 사용자 참여를 높이기 위해 미얀마 로힝야 소수민족에 대한 혐오 콘텐츠를 추천했고, 이는 비극적인 대량 학살로 이어졌다. 이는 AI 정렬 문제를 해결해야 할 필요성을 더 강조하고 있다.

FDA의 의약품 승인이나 FAA의 비행 운항 허가와 같은 잘 확립된 규제 체계와 비교하여, 일부에서는 AI 에이전트에 대해서도 유사한 규제가 필요하다고 주장한다. 벤지오는 에이전트가 사회에 필수불가결한 존재가 되면, 그들의 유용성과 경제적 가치로 인해 위험해진 시점에는 너무 늦어 그 발전을 되돌리기 어려울 수 있다고 경고한다. 한번 풀려난 지니를 다시 병 속에 넣을 수 없듯이, AI의 잠재력을 풀어놓기 전에 신중을 기하는 것이 필수적이다. 궁극적으로, 의료 분야의 AI 에이전트가 가장 먼저 규제 감독 대상이 될 것으로 보이는데, FDA 인증의 기본 원칙으로 알려진 "해를 끼치지 말라"는 명언이 의료 AI 에이전트 개발의 근간이 될 것이며, 이는 AI의 위험을 세밀하게 평가할 수 있는 프레임워크의 필요성을 촉구하는 것이다.

In the rapidly evolving landscape of artificial intelligence, a new era is dawning with AI agents that possess greater autonomy than traditional chatbots. This raises a crucial question: Are we prepared to handle agents that could surpass human capabilities?

One of the standout features at CES 2025 was the prevalence of IoT sensors. These sensors play a crucial role, akin to the senses of the human body, providing essential data for understanding and interpreting the environment. The adage "garbage in, garbage out" remains true even in the age of AI, emphasizing the need for high-quality data. The current trend in AI is moving toward agent-based systems. These agents, developed by AI companies, are designed to perform specific tasks on behalf of individuals or organizations and interact autonomously with external applications. While some experts highlight the benefit of reducing repetitive white-collar tasks, there is a concern that prioritizing speed over safety could pose significant risks. The widespread use of AI agents could indeed lead to legal and economic challenges.

AI agents, which operate autonomously with minimal human intervention, are becoming a key focus for big tech companies, securing massive investments. OpenAI has introduced its agent named "Operator," claiming it to be a step toward Artificial General Intelligence (AGI), specifically the third of five stages. Meanwhile, Mark Zuckerberg of Meta has predicted that AI agents will ultimately outpace humans, leading to job cuts, including laying off 3,600 software engineers.

Despite the darker forecasts surrounding AI agents, there are optimistic views as well. Iason Gabriel, a senior researcher at Google DeepMind, has announced Project Astra, which aims to move beyond simple tasks to support relationship-oriented and cognitive growth, assisting individuals in making informed decisions. Additionally, Silvio Savarese, Chief Scientist at Salesforce, foresees AI agents like their platform Agentforce assisting not just enterprises but individuals. These agents will remember user preferences and past interactions to handle tasks like planning vacations, booking flights, securing restaurant reservations, and adapting to unforeseen travel situations. Amazon is also reported to be developing an agent that recommends products based on shopping history.

AI agents can potentially outperform humans by linking powerful AI models and utilizing reinforcement learning to optimize performance with each iteration. Although the ontological connection between agents and consciousness exists, there’s no indication that AI will develop self-awareness. Big tech companies are not advertising their AI as near free will. However, given human evolutionary tendencies, people might perceive AI agents as sentient.

Experts expressing serious concerns about the implications of AGI development through AI agents argue for the introduction of legal regulations. Consider a scenario in the financial sector where an agent violates a contract; should the responsibility lie with the company or the agent itself? Just as corporations are granted personhood, we might have to consider affording AI agents similar status to address such issues. There is also the fundamental alignment problem: as AI agents' autonomy increases, their decision-making processes may become incomprehensible to humans. Yoshua Bengio, a renowned AI researcher, points out the conflict of interest between profit maximization and public safety. For instance, Facebook's algorithms once recommended hate content about Myanmar's Rohingya minority to boost user engagement, which led to tragic genocidal outcomes. This underscores the need to resolve AI alignment issues.

Drawing parallels with well-established regulatory frameworks like FDA’s drug approval or FAA’s flight operation permits, some argue for similar regulation for AI agents. Bengio warns that once agents become integral to society, their utility and economic value might prevent the reversal of dangerous developments. The genie cannot be put back into the bottle; thus, caution is imperative before unleashing AI’s potential.

Ultimately, AI agents in healthcare are likely first to fall under regulatory scrutiny. The fundamental principle of "do no harm" from FDA certification will likely underpin the development of medical AI agents, emphasizing the need for a framework to assess AI's risks meticulously.

참고원문 (References)